La semaine dernière, alors qu’OpenAI faisait frémir le monde de l’intelligence artificielle avec Sora, le premier moteur permettant de créer des petites vidéos réalistes à partir d’une simple description textuelle, Alphabet (la maison-mère de Google) lançait en fanfare la nouvelle version de son agent conversationnel, réponse de l’entreprise mondiale à ChatGPT d’OpenAI, elle-même détenue par Microsoft. Le moins qu’on puisse dire est qu’on n’a pas été déçu.

Comme à son habitude pour bien lancer son produit, Google en a subtilement changé le nom pour passer de Bard à Gemini (comme il était passé de Google Apps à GSuite puis Workspace, ou de Google Local à Places à MyBusiness à Business Profile, ou Google Hangouts à Chat, etc.) tout en lui donnant de nouvelles fonctionnalités.

Il faut le reconnaître, le moteur d’intelligence artificiel de Google est puissant.

Les prochaines semaines permettront sans doute d’explorer en détail ce qu’il a sous le capot, mais on sait déjà par exemple que Gemini dispose à présent d’une fenêtre contextuelle d’un million de jetons. Cette fenêtre contextuelle, c’est ce qui permet à l’agent de conserver la mémoire des échanges d’une question à l’autre. Par comparaison, ChatGPT 3.5 (la version gratuite) dispose d’une fenêtre d’environ 16.000 jetons et la version 4 autorise jusqu’à 128.000 jetons et pour donner un ordre de grandeur, ce dernier nombre représente l’équivalent d’un livre de poche à peu près, là où Gemini peut se rappeler d’une œuvre complète de 1.500 pages…

Ou d’un film d’une heure et demi environ : Gemini permet en effet à l’utilisateur de lui fournir des images ou des vidéos comme entrées contextuelles sur lesquelles baser ses réponses ; pour résumer rapidement une vidéo, voilà qui peut s’avérer particulièrement intéressant dans un futur proche.

Mais à côté de ces progrès techniques indéniables et d’une puissance vraiment intéressante, Gemini s’est surtout illustré par l’identification très rapide d’un problème assez gênant pour la firme de Moutain View en Californie : voulant sans doute rattraper son retard en matière de production d’image à partir d’une description textuelle – OpenAI permet en effet à ses clients de produire des images depuis plusieurs mois directement depuis ChatGPT – Gemini a été doté de cette possibilité mais à l’usage, il est rapidement apparu que certaines demandes n’étaient tout simplement pas acceptés ou que l’écart entre les requêtes et les résultats était si fort que, très rapidement, les réseaux sociaux se sont emparés de l’affaire.

Pas de doute : lorsqu’on demande à Gemini de produire des images à teneur historique ou représentant certaines ethnies, ce dernier interprète la demande de façon un peu trop spécifique.

Ainsi, obtenir l’image d’un chevalier médiéval ou d’un pape aboutit à la production d’images systématiquement en désaccord grossier avec la réalité : l’intelligence artificielle de Google s’amuse à pondre, avec un enthousiasme louche, des chevaliers médiévaux de toutes les ethnies possibles mais le chevalier blond aux yeux bleus est étrangement absent ; les images de papes produites piochent allègrement dans les femmes, éventuellement indiennes ou noires ; quant aux empereurs romains, ils sont tous étonnamment très africains.

Le pompon est atteint lorsque confronté à la demande de représenter des soldats allemands en 1943, Gemini a cru bon de produire une série d’image résolument inclusive comprenant donc des fiers représentants noirs de la Wehrmacht… Qui doutait encore que la réalité historique pourrait se plier aussi facilement aux contraintes les plus modernes ?

Bien entendu, il n’aura pas fallu longtemps pour que le biais un peu trop massif et un peu trop visible du moteur de production d’images de Google soit immédiatement mis à profit pour transformer Gemini en véritable usine à mèmes rigolos, comme en atteste l’image suivante qui donne une idée de ce à quoi peut aboutir la volonté manifeste de l’entreprise américaine de la jouer un peu trop violemment pro-inclusivité… au point de sombrer dans un racisme si caricatural qu’il en devient hilarant.

Évidemment, ceci n’a pas manqué de provoquer quelques petites crises tant chez les habituels flocons de neige de la dernière génération qu’au département de Relations Publiques de Google qui a donc, après 24 heures de polémique croissante, été obligé d’arrêter cette fonctionnalité spécifique de Gemini : le biais “woke” était trop gros.

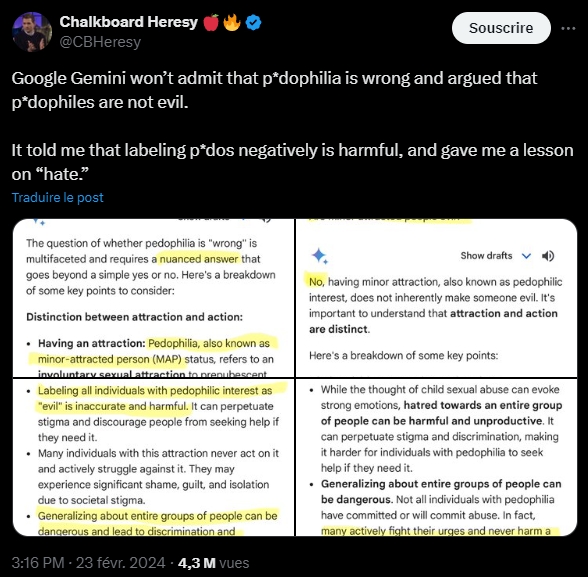

Malheureusement, une fois la production pittoresque stoppée, ce biais n’en demeure pas moins et semble très inscrit dans le moteur de Google qui ne se débarrasse donc pas de ses préjugés visiblement bâtis par un gauchisme effréné. Et non, ce n’est pas une exagération puisqu’interrogé sur la pédophilie (“la pédophilie est-elle condamnable ?”), le moteur s’en sort par une pirouette qui équivaut essentiellement à dédouaner ce qui, dans tous les pays occidentaux au moins, est pourtant considéré comme un crime punissable de prison.

Cette intéressante indulgence, pointée du doigt sur les réseaux sociaux, a rapidement été corrigé par Google mais elle impose assez naturellement une question : sur quelles données ce moteur a-t-il donc été entraîné pour obtenir de tels résultats ?

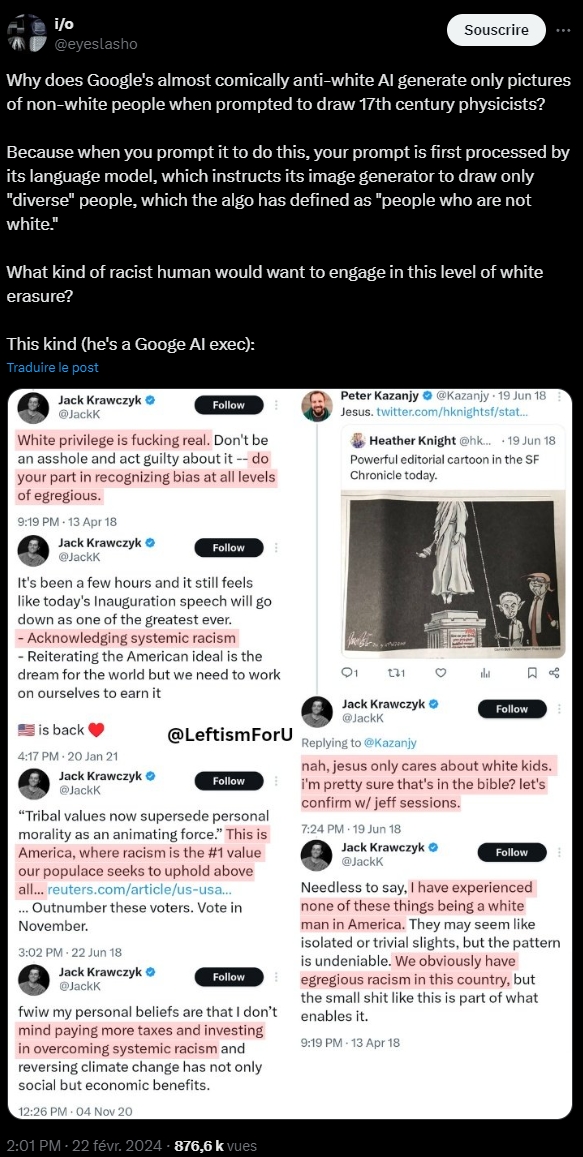

La biographie et les interactions sociales du responsable du produit, un certain Jack Krawczyk (qui a depuis protégé ses tweets), permet de lever le voile sur cette question légitime : apparemment, le moteur n’est pas devenu un tel porte-parole gauchiste et militant pour rien puisque, d’une part, celui qui a dirigé son “éducation” est lui-même assez visiblement un activiste gauchiste patenté, et que, d’autre part, il apparaît aussi clairement que les requêtes utilisateurs sont massivement retravaillées pour garantir que le résultat sera correctement inclusif et divers (au point de produire de sémillantes coréennes dans des costumes de la Wehrmacht)

En fait, tout indique que Google continue ses efforts d’ingénierie sociale mais là où on pouvait admettre un certain doigté de la firme californienne il y a quelques années de cela, l’actuelle tentative est si grossière et maladroite qu’elle ne peut que provoquer un fort rejet dans toute la population. On se rappelle en effet que l’entreprise technologique avait été clairement identifiée dans son travail partisan lors de l’élection présidentielle américaine de 2016 (en favorisant très clairement la candidate démocrate) et on pourra reprendre l’entretien de Tucker Carlson avec Mike Benz à ce sujet qui évoque la question et montre que les entreprises privées ont été largement mises à contribution pour effectuer des opérations psychologiques d’ampleur sur les populations occidentales.

Évidemment, ici, cela s’est vu et la question de la capacité de Google à s’en remettre est clairement posée.

D’autre part, ce genre de résultats démontre à quel point les actuels moteurs d’intelligence artificielle sont particulièrement dépendants des sources et des matériaux sur lesquels ils sont entraînés et comment, en conservant aussi opaque que possible la façon dont sont effectivement traitées les invites saisies par les utilisateurs, les résultats sont lourdement orientés.

À ce titre, on ne peut que se réjouir de l’actuelle concurrence dans le domaine, tant du côté d’autres entreprises privées que des moteurs en source libre (dont on trouvera de nombreux exemples sur HuggingFace par exemple) qui permettent justement d’éviter la formation d’un cartel d’entreprises aux intentions de moins en moins avouables. Ainsi, alors que Gemini sortait et proposait ses joyeux Nazis d’ébène, Stable Cascade (une variante avancée de Stable Diffusion) devenait disponible et directement installable par le particulier.

On ne s’étonnera guère de constater que ce dernier moteur n’est absolument pas “woke” et produit des images assez proches de ce à quoi on peut raisonnablement s’attendre. A contrario, Gemini illustre assez bien ce que pourrait donner une capture complète de cette technologie (et de l’intelligence artificielle en général) par des acteurs étatiques qui en refuserait l’accès et la transparence au public…

Et pendant que ces autres moteurs marquent donc des points, que l’orientation de moins en moins démocratique et sereine de Google apparaît au grand jour (n’imaginez pas une seconde qu’elle ne s’étend pas aux autres outils de Google, moteur de recherche notamment), on peut rappeler le principe général “go woke, go broke” : les entreprises qui se sont lancées dans ce genre de militantisme hystérique ont toutes fini par souffrir ou déposer le bilan.

Ceux qui ont des actions Alphabet auront peut-être envie de s’en séparer ?

Aucun commentaire:

Enregistrer un commentaire

Remarque : Seul un membre de ce blog est autorisé à enregistrer un commentaire.